看看哪些公司作妖了呢?

编者按:本文来自微信公众号“新智元”(ID:AI_era),作者:新智元。

【新智元导读】万圣夜还没到,迪士尼就放大招了:「无皮」机器人!OMG!不仅如此,它的眼睛还跟真人一样能与你对视。研究团队称,与真人精准交互一直是该领域的挑战,这项研究把「逼真」发挥到了一个新高度。万圣夜前,我们也搜罗了下那些年「吓死人」的机器人们!

万圣节要到了!看看哪些公司作妖了呢?

吓死不偿命的机器人感受一下:

您品品:

您细品:

如您所见,这个机器人不仅「无皮」,眼珠子似乎也在紧盯着你……

更可怕的是,这个惊悚万分的机器人不是什么恐怖公司造的,而是迪士尼!

微妙的头部及眼部运动:把仿生做到极致

与真人交互是研发机器人的关键步骤。

但当你和一个机器人互动时,最明显的一个特征就是他们呆滞的眼神。

迪斯尼的一个研究小组正试图通过使用微妙的头部和眼部运动来解决这个问题,使机器人看起来更逼真。

这个机器人穿着一身正经的白衬衫,这么看来舒服多了:

在一篇题为《真实和互动的机器人凝视》(Realistic and Interactive Robot Gaze)的论文中,研究人员描述了他们的开发过程,通过安装在胸部的传感器,机器人可以识别出人是否试图直接与它交流。

有时还会转过来面对他们。外部刺激可能导致机器人暂时转移视线,试图确定声源,但最终会回到关注人的脸上。

模拟呼吸引起的头部运动,甚至简单现实的眨眼动作可以。

SKELETON + CURIOSITY SCORE

那么机器人是如何做到以上交互的呢?

SKELETON(骨架) + CURIOSITY SCORE(好奇分数)就是机制的核心。

骨架拟合是通过以wrnch3为核心的感知引擎进行的。

感知引擎在2D中匹配骨架,然后深度项目提供3D关节位置。

每个骨骼由以下几个有趣的点组成:眼睛,鼻子,耳朵,脖子,肩膀,肘部,手腕,臀部,膝盖,脚踝,大脚趾,小脚趾和脚跟。

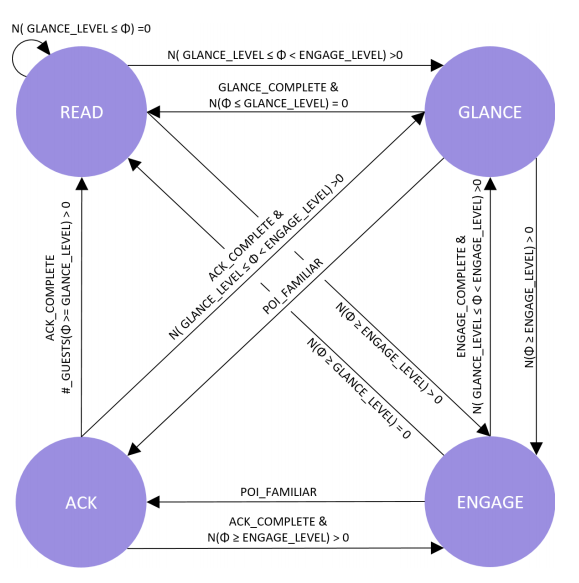

该机器人凝视交互架构由三个部分组成:注意引擎、行为选择引擎和行为库。整体系统架构如图:

注意力引擎

首先,摄影机会从视觉场景中取得所有人的3D位置,并随着时间的推移平滑输入的数据。每个检测到的骨架都有一个数值来区分场景中的人物。通过这些数据,注意力引擎可以估计人们是否在做某些动作,比如挥手,还可以计算人们移动的速度。

注意力引擎会生成一个「好奇心分数」,对于每个场景中的人,「好奇心分数」会使用函数来选择特征选择。

行为选择引擎

行为选择引擎是机器人角色系统的组成部分,它代表角色的高级推理。该组件包含一个手工制作的状态机,用于指导机器人处于哪种行为状态。行为选择引擎还维护有关机器人参数的信息(例如,当前状态,好奇阈值,状态超时时间),以及摄像头看到的骨架。

有四种状态

• read(也是默认状态)

• Glance

• Engage

• Acknowledge

行为选择引擎中的状态。N(condition)表示场景中检测到的满足条件的人数

也许迪士尼的远期目标是把这些机器人放置在游乐园里,但是,在这之前,迪士尼最好给这些机器人戴上一些假的硅胶皮肤。

毕竟,没有人愿意亲眼看到这场噩梦。

那些年,科学怪人们设计的恐怖机器人

人工智能时代的产物有时候令人毛骨悚然。以下是五个目前存在的机器人,它们的惊悚程度不比万圣节的传说差。

1 「CB2」

看这个外形,就知道这是日本人制造的了。

一种「咒怨」既视感~

这种儿童机器人具有仿生身体(CB2),是由大阪大学石黑浩教授开发的,旨在研究机器人中类人的认知发展。

自2007年问世以来,它一直通过记录人类的面部表情(眼睛摄像头)进行学习,将它们与身体感觉进行匹配,然后将它们分类(快乐、悲伤……)。这意味着,CB2正在经历与一个孩子相同的发展过程。

2 人嘴机器人

同样来自日本,不过这个东西又恐怖又搞笑:

这台机器由电机控制的器官,包括八根声带、一个橡胶的鼻腔和一个可以制造声音的硅胶嘴,它可以说话、唱歌。它产生的声音与我们完全相同:使用压缩机将空气通过工程声带和重建的塑料嘴进行输送。

这美丽的「香唇」,你觉得怎么样?

3 索菲亚

这个女性机器人是在中国香港建造的,还参加过一些重要的电视谈话节目,并获得了沙特阿拉伯公民身份。

4 「双胞胎」

这款机器人同样来自石黑浩教授。这位鬼才对人形机器人可以说是相当的执着。

他还给自己做了个「兄弟」:使用自己的体形模型,将自己的肢体语言和声音编入程序,甚至将自己的头发植入机器人的头部。

考虑到「模糊人与机器人之间的界限」以及「灵魂可以存在于任何事物中」的说法,似乎,石黑郎从根本上使他的机器人双胞胎成为了现实。

trick or treat?